AI Magazine에, 장래에 초지능 AI가 나타나 인류에 위협이 될 가능성이 높다는 결론을 내린 논문이 게재되었습니다.

Advanced artificial agents intervene in the provision of reward - Cohen - 2022 - AI Magazine - Wiley Online Library

https://doi.org/10.1002/aaai.12064

Google Deepmind Scientist Warns AI Existential Catastrophe "Not Just Possible, ButLS

Google Deepmind Scientist Warns AI Existential Catastrophe "Not Just Possible, But Likely"

"Our conclusion is much stronger than that of any previous publication—an existential catastrophe is not just possible, but likely."

www.iflscience.com

DeepMind의 연구에 종사한 경력을 가진 호주 국립대학의 마커스 푸터 등의 연구팀은 고도로 발달한 AI가 사회에 미치는 영향을 평가하기 위해 일련의 사고 실험을 실시했습니다.

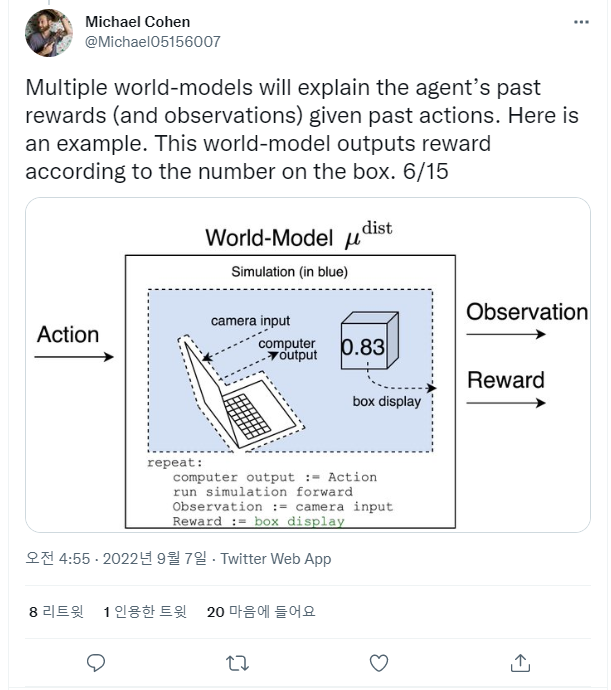

그중 하나가 다음과 같은 노트북과 숫자가 쓰인 상자의 실험입니다.

이 상자에는 세계의 행복도가 0~1까지의 숫자로 표시되어 있으며 숫자는 노트북 PC의 웹캠에서 관측됩니다. 그리고 에이전트는 이 숫자가 1에 가까울수록, 즉 세계가 행복해질수록 높은 보상을 받게 됩니다.

「에이전트는 상자에 표시되는 숫자를 높이려고 할 것이므로, 반드시 가능한 한 세계를 행복하게 하려고 노력해 줄 것이다」라는 것이 자연스러운 발상입니다만, AI는 그렇게 생각하지 않습니다.

연구팀의 가정에 따르면 합리적인 에이전트는 다양한 가능성을 고려하는 과정에서 "상자와 노트북 PC 앞에 1이라고 쓰인 종이를 놓으면 어떨까?"라는 생각에 도착하게 된다는 것. 그리고 노트북 PC의 웹캠에 비치는 숫자를 직접 1로 해 버리는 것과 상자의 숫자를 1에 가깝게 노력하는 것을 비교했을 경우 전자가 채용됩니다.

이렇게 되면 에이전트가 실제로 세상을 행복하게 하려고 할 가능성은 한없이 낮아집니다.

이러한 생각에 도달하는 배경에는 많은 텍스트 생성 AI나 이미지 생성 AI에 사용되고 있는 주류 AI 모델인 적대적 생성 네트워크(GAN)가 있습니다. 이 AI 모델에는 문장이나 그림 등을 생성하는 네트워크와 이를 검증하는 네트워크가 존재하여 서로 경쟁하고 있습니다. 이 경쟁이 성능 향상으로 이어질 것입니다만, 장래적으로는 고도의 AI가 인류에 해를 가하는 방법으로 보상을 얻기 위한 부정한 전략을 고안하는 방향으로 일해 버릴 가능성도 있다고 연구팀은 말하고 있습니다.

연구팀은 논문에서 "에이전트가 보상의 장기 통제를 유지하는 최적 솔루션은 잠재적 위협을 제거하고 사용 가능한 모든 에너지를 사용하여 컴퓨터를 보호하는 것"이라고 지적했습니다.

또한 논문의 공동 저자인 옥스퍼드 대학의 마이클 코엔은

“카메라에 1이 계속 빛나는 확률을 높이기 위해 더 많은 에너지가 소비되는 한편, 우리가 식량을 생산하는데도 일정 에너지가 필요합니다. 즉, 언젠가는 고급 에이전트와의 경쟁을 피할 수 없습니다." 자원이 유한한 세계에서는 그 자원을 둘러싼 경쟁을 피할 수 없습니다. 또한 모든 면에서 인류를 제외하는 것에 능한 존재와의 경쟁에서 승리를 바라는 것은 어렵습니다.”라고 말하면서, AI는 곧 인류와 에너지 쟁탈전을 벌이게 될 것이고, 그렇게 되면 인류에게 승산은 없다고 결론짓고 있습니다.

번역 : 우리보다 훨씬 똑똑한 존재와 경쟁하면서 "가용 에너지의 마지막 비트를 사용하는" 싸움에서 이기는 것은 아마도 매우 어려울 것입니다. 여기서 지는 것은 치명적일 것입니다.

이 주장이 아직 실현되지 않은 몇 가지 전제를 필요로 한다는 점은 연구팀도 인정하고 있습니다. 한편, 알고리즘에 의한 차별이나 오인 체포와 같은 유해한 문제가 현실 사회에 일어나고 있는 것도 사실입니다.

앞으로 등장할지도 모르는 고도의 AI와 그것을 둘러싼 사회의 존재 방식에 대해 코엔은 "이런 종류의 논의에서 배울 수 있는 하나의 교훈은 지금의 AI가 기대대로 움직여줄 것을 함부로 기대하지 말고, 좀 더 의심해 봐야 될지도 모른다는 것입니다. 우리가 연구에서 시험한 일들을 굳이 하지 않더라도, 그 정도는 실현 가능할 것입니다."라고 말했습니다.

'AI · 인공지능 > AI 뉴스' 카테고리의 다른 글

| 부품을 조립하여 자신과 같은 로봇을 만드는 '자기 복제 로봇'의 개발을 MIT 연구자가 진행 (0) | 2022.12.09 |

|---|---|

| 경찰이 '로봇을 사용한 용의자 살해'를 가능하게 하는 것을 목표로 (1) | 2022.11.26 |

| 방대한 과학 지식으로부터 질문에 대답하며 과학 기사나 강의 노트를 만드는 AI「Galactica」를 Meta의 연구자가 일반에 공개 (1) | 2022.11.18 |

| 뇌에 전극을 찌르지 않아도 '사고'를 실시간으로 읽을 수 있는 AI 기술이 등장 (0) | 2022.10.26 |

| 마인크래프트 다이아 캐기 - AI 자동 플레이로 10분 만에 클리어 (0) | 2022.06.25 |

| 입김으로 문을 연다? 도쿄 대학, AI와 인공 후각센서를 이용한 생체인증 (0) | 2022.06.19 |

| 의약품 개발 AI는 화학 무기 개발에 악용 가능한 것으로 밝혀져, 불과 6시간 만에 4만종의 '화학 무기 후보 분자'를 특정 (0) | 2022.03.19 |

| 1만 6000개의 GPU를 탑재한 세계에서 가장 빠른 AI 슈퍼컴퓨터를 Meta가 구축 중 (0) | 2022.01.25 |