이미지 생성 AI·Stable Diffusion에서 파라미터 수가 대폭 증가한 신모델 「Stable Diffusion XL(SDXL)」의 기술 리포트가 공개되었습니다.

SDXL은 기존의 Stable Diffusion에 비해 3배 더 큰 UNet 백본을 갖추고 있습니다. 모델 파라미터의 증가에 의해, SDXL에서는 어텐션 블록이나 대규모의 크로스 어텐션 컨텍스트를 이용할 수 있게 되어, 이것을 이용해 SDXL은 다수의 종횡비로 트레이닝 가능하게 되었습니다.

또, SDXL에 의해 생성된 샘플의 시각적인 충실도를 향상시키기 위해서, 이미지를 프롬프트로 입력해 새로운 이미지를 생성하는 기술 「image-to-image(img2img)」를 사용해 모델을 개량하고 있다고 합니다.

아래의 그래프는 이미지 생성 AI가 작성한 이미지가 어느 정도 유저의 기호에 합치하고 있는지 정리한 그래프입니다.

세로축이 높을수록 사용자가 선호하는 이미지를 생성 가능하다는 것입니다. SDXL은 이미 Stable Diffusion 1.5나 2.1보다 분명히 뛰어난 퍼포먼스를 보이고 있어, 리파인먼트 스테이지를 추가(SDXL w/Refiner)하는 것으로, 퍼포먼스를 한층 더 향상할 수 있다는 것이 나타났습니다.

또한, 이전 버전의 Stable Diffusion에서는 피사체의 머리와 다리가 프레임에서 잘라진 이미지가 생성되는 경우가 많았습니다. 이것은 트레이닝 데이터에 임의의 트리밍 이미지(피사체의 일부가 올바르게 프레임에 들어가지 않은 이미지)가 포함되는 것으로, AI가 「피사체의 머리나 발이 프레임으로부터 잘라진 이미지」로 학습했기 때문입니다.

SDXL에서는 이 문제를 해결하기 위해, 트레이닝 중에 랜덤 트리밍 이미지를 사용하면서 AI 모델이 "트레이닝에 사용하고 있는 이미지가 일부 트리밍되어 버린 것"임을 인식하게 되었고, 모델에 좌표를 추가하고 있습니다. 좌표 정보를 추가함으로써 AI 모델은 피사체를 중심으로 유지하면서 다양한 크기의 이미지를 생성할 수 있게 된 모양입니다.

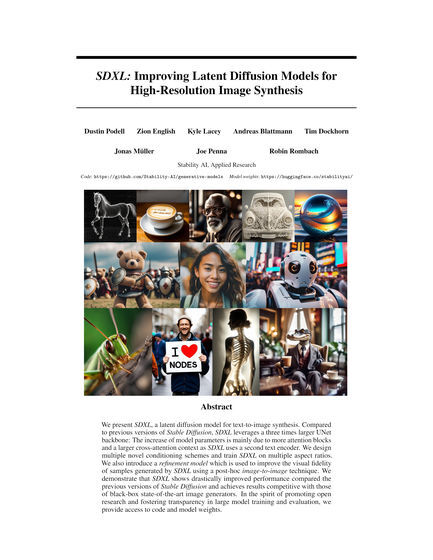

다음은 Stable Diffusion 버전 1.5, 2.1, SDXL의 세 가지 버전으로 동일 프롬프트로 이미지를 생성하고 각각을 비교한 것입니다. 왼쪽이 "프랑스 나폴레옹으로 분장한 고양이가 치즈를 가지고 있는 프로파간다 포스터"라는 프롬프트로 이미지를 생성한 경우이고, 오른쪽이 "불을 내뿜는 드래곤의 클로즈 업, 시네마틱 샷"이라는 프롬프트로 이미지를 생성한 경우입니다.

Stable Diffusion의 버전 1.5와 2.1에서는 고양이와 드래곤이 화면에 꽉 차는 케이스가 종종 보입니다만, SDXL에서는 깨끗하게 고양이나 드래곤이 프레임 안에 들어가는 것을 볼 수 있습니다.

SDXL은 단일 모델이 아니라 2단계 모델을 채용하고 있습니다. 2단계 모델 중 하나는 '이미지의 전체'를 획득하도록 훈련된 모델'이며, 다른 하나는 '첫 번째 모델의 출력을 개선하고 텍스처와 세부 사항을 수정하는 모델'입니다. 이러한 모델은 별도로 교육할 수 있으므로 학습 효율도 향상됩니다.

그 밖에도 SDXL의 기술적 세부사항이 리포트로 정리되어 있습니다.

generative-models/assets/sdxl_report.pdf at main · Stability-AI/generative-models · GitHub

https://github.com/Stability-AI/generative-models/blob/main/assets/sdxl_report.pdf

'AI · 인공지능 > 이미지 생성 AI' 카테고리의 다른 글

| 확산 모델을 사용하여 흑백 이미지를 컬러로 바꾸는 「 Color Diffusion」 (2) | 2023.08.14 |

|---|---|

| Stability AI의 「SDXL 1.0 모델」웹 앱이 공개되었습니다 (1) | 2023.07.27 |

| Meta가 이미지를 텍스트로, 텍스트를 이미지로 변환하는 AI 「CM3leon」 발표 (14) | 2023.07.19 |

| 스케치를 이미지로 변환해주는 「Stable Doodle」을 Stability AI가 출시 (3) | 2023.07.17 |

| 이미지 배경삭제 오픈 소스 라이브러리 「background-removal-js」 (3) | 2023.07.03 |

| AI 생성 이미지를 판별할 수 있다고 자칭하는 여러 툴을 테스트한 결과란? (6) | 2023.07.03 |

| AI로 이미지를 움직여 수정하는 툴 「DragGAN」의 소스 코드&데모 공개 (3) | 2023.06.27 |

| 「Stable Diffusion」의 고성능 모델 「SDXL 0.9」를 Stability AI가 발표 (3) | 2023.06.26 |