기존의 텍스트에 의한 음악 생성에서는 비트의 위치나 음악의 강약 등, 시간에 따라 변화하는 속성을 제어하는 것이 어려웠습니다. 그래서 카네기 멜론 대학과 Adobe Research의 연구팀이 여러 시간적 변화 컨트롤을 가능하게 하는 음악 생성 모델 「Music ControlNet」을 발표했습니다.

[2311.07069] Music ControlNet: Multiple Time-varying Controls for Music Generation

https://arxiv.org/abs/2311.07069

Music ControlNet: Multiple Time-varying Controls for Music Generation

Text-to-music generation models are now capable of generating high-quality music audio in broad styles. However, text control is primarily suitable for the manipulation of global musical attributes like genre, mood, and tempo, and is less suitable for prec

arxiv.org

Music ControlNet

https://musiccontrolnet.github.io/web/

Music ControlNet

Music ControlNet: Multiple Time-varying Controls for Music Generation Shih-Lun Wu1,2* Chris Donahue1 Shinji Watanabe1 Nicholas J. Bryan2 1School of Computer Science, Carnegie Mellon University 2Adobe Research *Work done during an internship at

musiccontrolnet.github.io

근래에 텍스트를 바탕으로 음악을 생성하는 AI 모델은 다수 등장하고 있으며, Meta는 텍스트로 음악과 효과음을 생성하는 오픈소스 툴 「AudioCraft」도 발표하고 있습니다. 그러나 연구팀은 "텍스트에 의한 컨트롤은 주로 장르나 분위기, 템포 등 전반적인 음악 속성의 조작에 적합하며, 비트의 시간적 배치나 음악의 강약 변화 등 시간에 따라 변화하는 속성을 정확하게 제어하기에는 별로 적합하지 않다."라는 것입니다.

그래서 연구팀은 오디오에 대해 여러 시간적 속성의 컨트롤을 제공하는 확산 모델(diffusion model)을 기반으로 한 음악 생성 모델 "Music ControlNet"을 개발했습니다. Music ControlNet에서는, 텍스트로부터 음악을 생성하는 모델에 시간적 제어를 심기 때문에, 「ControlNet」이라는 신경 네트워크와 유사한 어프로치를 도입하고 있다고 합니다.

ControlNet은 사전 학습된 모델에 대해 윤곽선이나 깊이, 이미지의 영역 구분(세그먼테이션) 정보 등을 추가하여 출력을 지원하는 기술로, 이미지 생성 모델과 조합하여 생성된 이미지의 품질을 향상할 수 있습니다. 연구팀은 이를 이미지가 아닌 음악 생성 모델에 적용한 것입니다.

Music ControlNet: Multiple Time-varying Controls for Music Generation - YouTube

기존의 텍스트로부터 음악을 생성하는 모델에서는, 단순히 「Powerful rock」이라는 텍스트를 바탕으로, 그러한 음악을 AI가 생성하고 있었습니다.

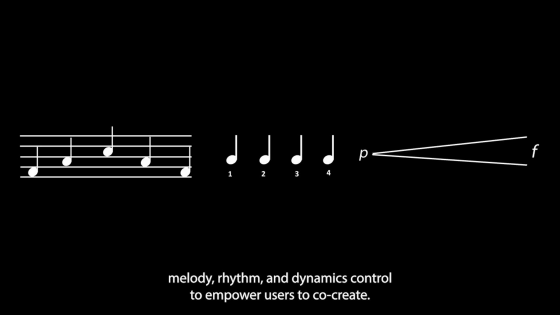

Music ControlNet은 이 외에도 멜로디, 리듬, 역학 등의 시간적 속성을 제어하는 능력을 갖춘 새로운 음악 생성 모델입니다.

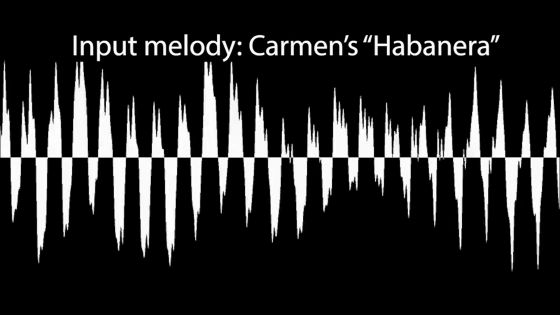

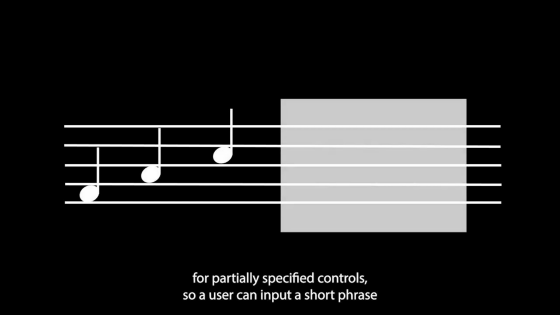

Music ControlNet에서는 텍스트뿐만 아니라 원하는 멜로디를 입력할 수 있습니다. 이 영상에서는 예를 들어 카르멘의 "하바네라" 멜로디를 입력하고 있습니다.

입력한 멜로디와 'Angry, Hip-hop'과 같은 텍스트를 조합하여 멜로디를 유지한 채, 힙합으로 마무리할 수 있습니다.

또한, Music ControlNet에서는 음악의 일부만을 컨트롤해, 나머지는 AI에게 맡길 수도 있다고 합니다.

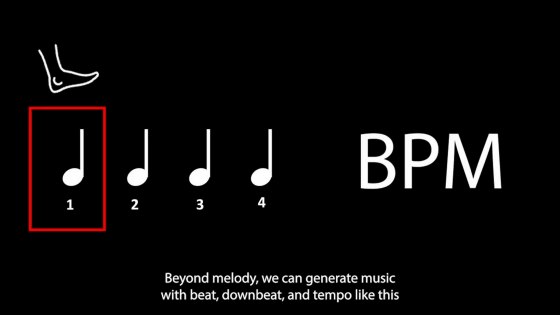

템포, 비트, BPM을 조정할 수도 있습니다.

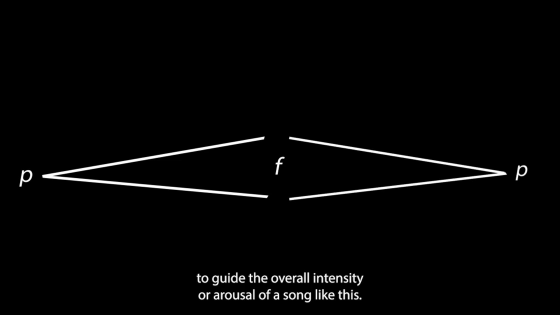

음악의 역학을 지정할 수도 있습니다.

점점 강해지도록 지시했는데, 처음에는 소박한 곡조로 시작됩니다.

그리고 점차 곡조가 강해졌습니다.

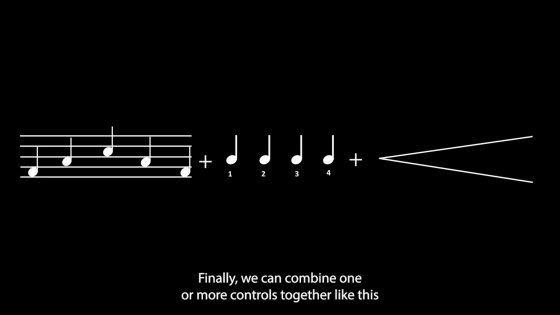

여러 요소를 동시에 제어할 수도 있습니다.

이건 미쳤다...

'AI · 인공지능 > AI 뉴스' 카테고리의 다른 글

| ChatGPT 개발자 OpenAI의 임시 CEO로 취임한 미라 무라티는 누구인가? (47) | 2023.11.21 |

|---|---|

| Google DeepMind가 음악 생성에 특화된 AI 모델 'Lyria'를 발표 (56) | 2023.11.20 |

| AI로 존 레논의 목소리만 꺼내 완성한 비틀즈의 마지막 신곡 'Now and Then' 뮤직비디오를 공개 (4) | 2023.11.19 |

| Amazon이 GPT-4를 넘는 2조 파라미터의 대규모 언어 모델 「Olympus」를 개발중 (1) | 2023.11.17 |

| 구글 DeepMind가 1분 만에 10일간의 날씨를 예측할 수 있는 AI「GraphCast」를 발표 (52) | 2023.11.16 |

| 손바닥에 투영 가능한 클립형 웨어러블 디바이스 「Ai Pin」을 Humane가 정식 발표 (53) | 2023.11.15 |

| 「☆→@로 변경」등의 메일 주소 난독화 수법은 ChatGPT로 간단하게 돌파 가능 (84) | 2023.11.13 |

| OpenAI가 저작권 침해로 법적 청구가 발생할 경우 사용자를 보호하고 비용을 전액 지불하는 '저작권 실드'를 발표 (2) | 2023.11.13 |