2022년 후반부터 'ChatGPT'와 'Bard' 등 수많은 대규모 언어 모델(LLM) 및 AI 서비스가 등장해 전 세계 사용자들이 생성 AI를 적극적으로 사용하기 시작하게 되었습니다. 이러한 대규모 언어 모델의 대부분은 기계 학습 모델과 데이터 세트의 리포지토리인 Hugging Face에 기탁되고 있습니다만, 스탠퍼드 대학의 연구자들이 Hugging Face의 데이터를 정리해 시각화한 것을 새롭게 공개했습니다.

[2307.09793] On the Origin of LLMs: An Evolutionary Tree and Graph for 15,821 Large Language Models

https://doi.org/10.48550/arXiv.2307.09793

Constellation

Constellation

Stanford University Constellation: An Atlas of 15,821 Large Language Models https://llmconstellation.olafblitz.repl.co/

constellation.sites.stanford.edu

위의 Constellation에 액세스 하고 Access Constellation을 클릭합니다.

다음으로 표시할 LLM을 지정합니다.

위의 숫자는 최소 다운로드 수이며, 입력한 숫자보다 Hugging Face에서 다운로드를 더 많이 한 것만 표시됩니다. 이렇게 하면 인기 있는 LLM만으로 범위를 좁힐 수 있습니다. 아래의 숫자는 클러스터 수라고 하며, 간단히 말하면 LLM을 몇 개의 그룹으로 나눌지를 지정하는 것입니다. LLM은 비슷한 것들로 그룹화됩니다.

'워드 클라우드 보이기'를 체크하고 「Run Clustering」을 클릭, 잠시 기다리면 일부 그래프가 표시됩니다.

그렇게 표시된 것은 필터링된 모든 LLM을 체계화한 수형도입니다. 매우 보기 어렵습니다만, 줌을 사용하면 확대해서 볼 수 있습니다.

ChatGPT나 Google Bard에 필적하는 정밀도의 LLM 「Vicuna-13B」는 어디로부터 파생했는지, 유사한 언어 모델은 무엇인지 등을 확인할 수 있습니다.

이것은 Louvain 법을 사용하여 각 LLM을 여러 커뮤니티로 나눈 그래프입니다. 깊은 연결이 있는 LLM은 하나의 커뮤니티로 간주되며 얇은 원으로 둘러싸여 있습니다. 각 노드에 커서를 맞추면 LLM의 이름, 다운로드 수 랭킹, 다운로드 수, Hugging Face에서 얻은 '좋아요' 수, 파라미터 수가 표시됩니다.

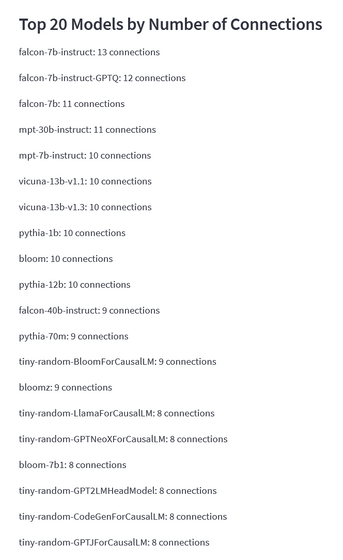

다음에 표시되는 것은 각 LLM과의 연결이 많은 LLM의 상위 20건을 정리한 리스트입니다. 오픈 소스로 상용 이용이 가능한 「Falcon」 모델이 상위 3건을 차지하고 있습니다.

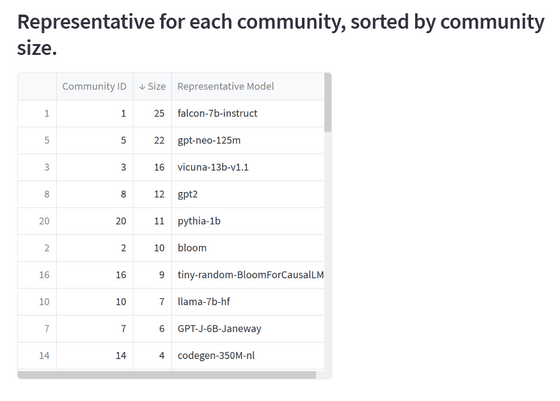

그러면 커뮤니티 규모를 기준으로 정렬된 LLM 목록이 표시됩니다. 가장 규모가 큰 것은 falcon-7b-instruct. 다음으로 큰 것이, 「GPT-3」 에 가까운 성능의 언어 모델을 오픈 소스로 목표로 하는 「GPT-Neo」 의 모델 중 하나인 gpt-neo-125m입니다.

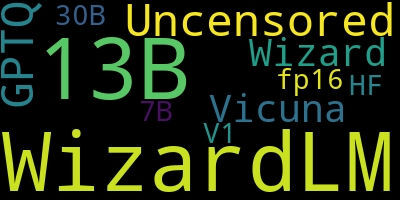

각 클러스터에 대해 어떤 모델이 돋보이는지 알 수 있는 워드 클라우드도 표시됩니다.

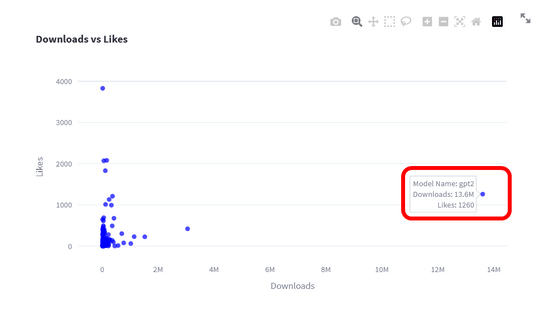

마지막으로 표시되는 것은 다운로드 수와 '좋아요' 숫자를 보여주는 그래프입니다. 혼자서 1,360만 건이라는 다운로드 수를 자랑하고 있었던 것은 OpenAI의 오픈 소스 LLM 「GPT-2」 였습니다.

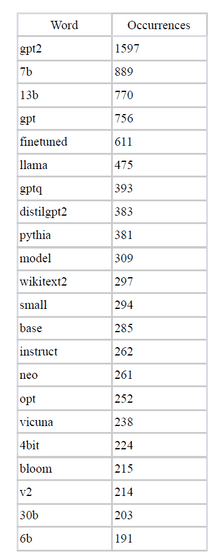

세상에 넘치는 LLM에는 「GPT」 나 「model」 등 비슷한 이름이 붙는 것이 많습니다. 이번 데이터 라이브러리를 작성한 연구자들은 LLM의 이름에 어떤 단어가 얼마나 등장하고 있는지를 세밀하게 나열하 논문에 기재하고 있습니다.

'AI · 인공지능 > AI 뉴스' 카테고리의 다른 글

| 프레임간의 일관성을 유지한 채, 영상에 텍스트를 지정하여 변경하는 기술 「TokenFlow」가 등장 (2) | 2023.07.26 |

|---|---|

| ChatGPT의 지능이 급격히 떨어지고 있다는 연구 결과, 간단한 수학 문제 정답률이 98%에서 2%로 악화 (3) | 2023.07.25 |

| ChatGPT나 LiDAR 센서를 탑재한 가정용 로봇 개 「Unitree Go2」가 발매된다 (2) | 2023.07.25 |

| Stability AI가 ChatGPT와 동등한 성능을 가진 오픈소스 대규모 언어 모델 'FreeWilly' 공개 (3) | 2023.07.24 |

| 「xAI」가 테슬라의 자동 운전에 AI를 활용, Twitter의 데이터는 AI 학습에 (2) | 2023.07.23 |

| AI의 구조를 애니메이션으로 변환해주는 Python 라이브러리 「ManimML」 (2) | 2023.07.23 |

| 사이버 범죄자가 비즈니스 사기 메일에 채팅 AI를 활용하는 「WormGPT」 (4) | 2023.07.21 |

| 「GitLab 16」등장 AI 워크플로우 기능을 탑재한 DevSecOps 플랫폼의 최신판 (3) | 2023.07.21 |