케임브리지 대학의 연구팀이 여러 레시피를 배운 로봇에게 그중 하나의 레시피에 관한 요리 동영상을 보여주자, 그 레시피를 재현하여 요리를 하는 「로봇 요리사」를 개발했습니다. 또한 이 로봇 요리사는 레시피의 재현뿐만 아니라 오리지널 레시피도 고안했다고 합니다.

Recognition of Human Chef's Intentions for Incremental Learning of Cookbook by Robotic Salad Chef | IEEE Journals & Magazine | IEEE Xplore

https://doi.org/10.1109/ACCESS.2023.3276234

Recognition of Human Chef’s Intentions for Incremental Learning of Cookbook by Robotic Salad Chef

Robotic chefs are a promising technology that can bring sizeable health and economic benefits when deployed ubiquitously. This deployment is hindered by the costly process of programming the robots to cook specific dishes while humans learn from observatio

ieeexplore.ieee.org

Robot 'chef' mimics recipes from food videos

https://www.newswise.com/articles/robot-chef-mimics-recipes-from-food-videos

Robot 'chef' mimics recipes from food videos

Researchers have trained a robotic ‘chef’ to watch and learn from cooking videos, and recreate the dish itself.

www.newswise.com

다른 사람이 요리를 하는 모습을 관찰하거나 요리 영상을 보면서 새로운 레시피를 배울 수 있는 인간과는 달리, 여러 레시피를 배우면서 요리를 만들도록 로봇을 프로그래밍하는 것은 매우 많은 비용과 시간이 걸리는 것으로 알려져 있습니다.

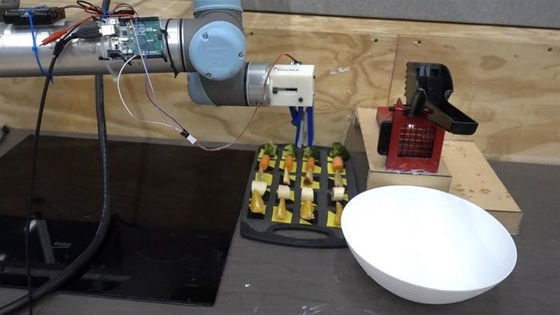

그래서 케임브리지 대학의 Grzegorz Sochacki 씨의 연구팀은 8 가지 간단한 샐러드 조리법을 고안하고 요리 동영상을 만들었습니다. 그 후 브로콜리와 당근, 사과, 바나나, 오렌지 등 야채와 과일을 포함한 다양한 개체를 개별적으로 인식할 수 있는 오픈 소스 신경망을 사용하여 로봇 요리사 교육을 실시했습니다.

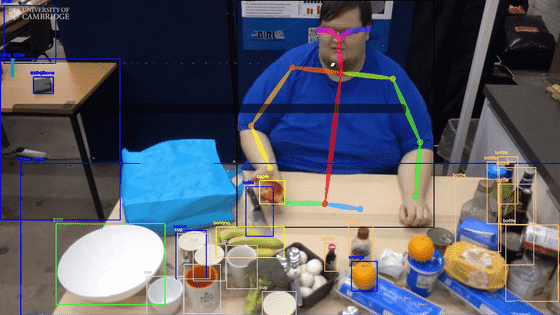

로봇 요리사는 디지털 동영상을 이해하는 컴퓨터 비전(컴퓨터를 이용해 정지 영상 또는 동영상으로부터 의미 있는 정보를 추출하는 방법을 연구) 기술을 응용하여 요리 동영상의 각 프레임을 분석하여 식칼과 재료뿐만 아니라 인간의 팔과 손, 얼굴 등 다양한 개체와 특징적인 행동을 식별하는 데 성공했습니다. 식별 과정에서 학습된 레시피와 동영상이 모두 벡터로 변환되고, 로봇은 이러한 벡터에 대해 수학적 연산을 수행하여 요리 영상과 벡터의 유사성을 평가합니다.

Sochacki 씨는 "인간이 손에 든 재료와 행동을 올바르게 식별함으로써 '로봇 요리사'는 8가지 요리법 중 어떤 요리법이 요리되고 있는지 판단할 수 있었습니다."라고 코멘트.

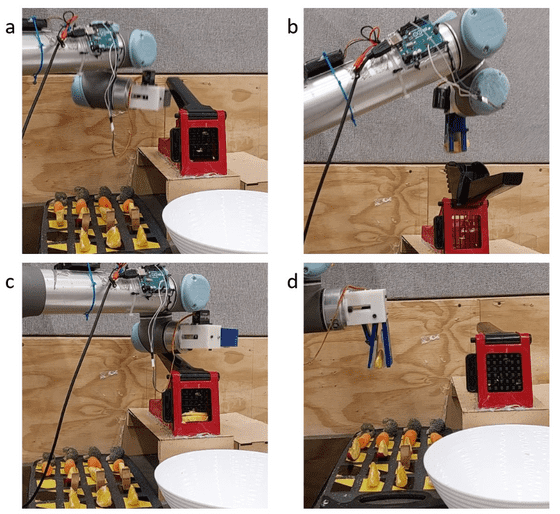

로봇 요리사의 실험에서는 인간이 한 손에 부엌칼을 가지고 다른 손에 당근을 가지고 있는 요리 동영상을 로봇이 관찰한 경우, 로봇은 손에 든 당근은 부엌칼로 잘게 자른다고 추측하여 재료를 잘라내는 장치를 움직입니다. 인간의 행동을 해석하고 이해함으로써 로봇은 요리 비디오만 보고도 조리법을 식별하는 데 성공했습니다.

다음은 실제로 움직이는 로봇 요리사의 영상입니다.

Robot 'chef' learns to recreate recipes from watching food videos - YouTube

Sochacki 씨는 사과를 로봇에게 보여줍니다.

또한 사과를 잘게 자르는 모습이 비치고 있습니다.

"사과를 자르다"를 이해한 로봇 요리사는 장비에 사과를 넣고 별도로 지시된 당근과 함께 잘라내는 데 성공했습니다.

연구팀에 따르면 로봇 요리사가 시청한 16개의 요리 영상 중, 인간 행동의 약 83% 만 검출해 냈음에도 불구하고 약 93%라는 고정밀도로 올바른 레시피를 식별해 냈습니다. 또한 로봇 요리사는 같은 레시피의 동영상 중 인간이 실수를 한 경우에도, 각각을 다른 신규 레시피로 간주하지 않고 모두 같은 레시피라고 판단한 것으로 보고되었습니다.

게다가 연구팀이 로봇 요리사가 학습한 적 없는 새로운 9번째 샐러드 레시피의 요리 동영상을 학습시켰는데, 로봇은 이 레시피를 올바르게 재현하는 데 성공했습니다.

Sochacki 씨는 "다진 사과 2개와 다진 당근 2개를 사용하는 레시피가 다진 사과와 당근을 각각 3개씩 사용하는 레시피와 같은 레시피라고 인식할 수 있었던 것은 놀라운 일입니다."라고 말합니다.

연구팀이 사용한 요리 동영상은 컷 편집이나 시각 효과 등을 포함하여 일반적인 요리 동영상과는 달리 재료를 명확하게 로봇에 제시하고 그것이 무엇인지 인식할 수 있는 동영상이 사용되고 있습니다. Sochacki 씨는 "이 로봇 요리사가 YouTube 등의 요리 동영상을 보고 즉시 따라 하는 것은 아직 어렵습니다."라고 남은 과제를 말합니다.

한편 로봇 요리사가 동영상의 재료를 보다 선명하고 빨리 식별할 수 있게 된다면 향후 YouTube 등의 사이트를 사용하여 다양한 레시피를 학습할 수 있게 될 가능성이 있다고...

과학계 정보 사이트 ScienceBlog는 "이번 캠브리지 대학의 연구팀에 의한 보고는 세상에 넘치는 요리 동영상 콘텐츠가 요리 자동화를 위한 귀중한 데이터 소스가 되어, 미래의 로봇 요리사를 만드는 데 있어서 보다 고정밀도의 저렴한 개발을 가능하게 할지도 모릅니다."라고 말하고 있습니다.

'AI · 인공지능 > AI 뉴스' 카테고리의 다른 글

| 유엔 사무총장이 AI 기술규제를 향한 국제자문기관의 설치를 제언 (3) | 2023.06.08 |

|---|---|

| GPU 없이 일반 가정 PC에서 채팅 AI를 동작시키는 라이브러리 「GGML」의 개발이 진행 중 (3) | 2023.06.08 |

| 적은 GPU 메모리로 대규모 언어 모델을 트레이닝 하는 기법 「QLoRA」가 등장 (4) | 2023.06.07 |

| 「ChatGPT」로부터 대답을 잘 끌어내기 위한 OpenAI의 공식 가이드 (3) | 2023.06.07 |

| 오픈 소스로 상용 이용도 가능한 대규모 언어 모델 「Falcon」이 등장, 오픈 소스 모델 중 최고의 성능 (4) | 2023.06.07 |

| ChatGPT 등의 대규모 언어 모델은 어떤 이론으로 성립되었는가? 중요논문 24선 정리 (3) | 2023.06.05 |

| TikTok에서 살인사건 피해자가 자신의 최후를 말하는 영상이 증가 중 (3) | 2023.06.05 |

| AI 탑재 드론이 표적 파괴 작전 시뮬레이션에서 자신의 오퍼레이터를 살해 (4) | 2023.06.05 |