ChatGPT 등의 채팅 AI는, 트레이닝뿐만 아니라 동작시키는데도 수십~수백GB의 VRAM 등 매우 높은 머신 스펙을 요구하는 것이 일반적입니다. 이러한 상황을 바꿀 수 있도록, GPU 없이 채팅 AI를 동작시키는 라이브러리 「GGML」의 개발이 진행되고 있습니다.

ggml.ai

http://ggml.ai/

ggerganov/ggml: Tensor library for machine learning

https://github.com/ggerganov/ggml

GitHub - ggerganov/ggml: Tensor library for machine learning

Tensor library for machine learning. Contribute to ggerganov/ggml development by creating an account on GitHub.

github.com

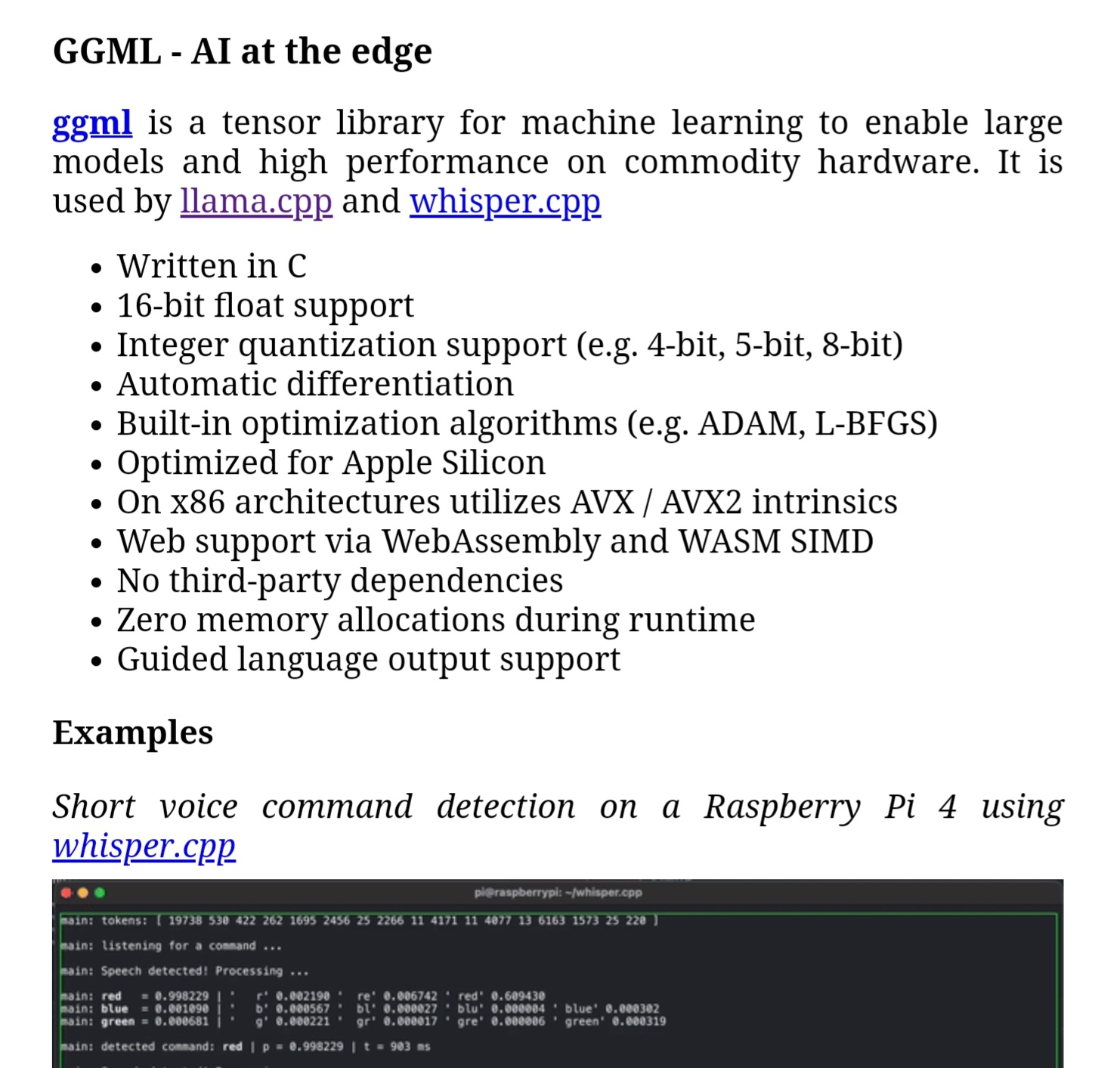

GGML의 특징은 아래와 같습니다.

・C언어로 작성

・16bit float를 서포트

・4bit, 5bit, 8bit 정수에서의 양자화를 서포트

・자동 미분

・x86 아키텍처에서는 AVX 및 AVX2를 사용

・WebAssembly와 WASM, SIMD에 의한 Web 지원

・타사 의존성 없음

・동작 중 메모리를 사용하지 않음

・지도(guidance)가 첨부된 언어 출력을 서포트

GGML 코드는 GitHub에 공개되었지만, "이 프로젝트는 아직 개발 중임을 명심하십시오."라고 굵게 표시되어 있습니다.

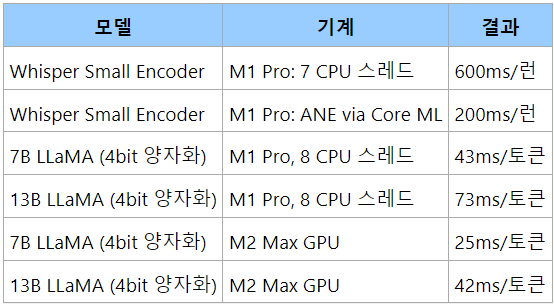

GGML은 개발 중인 프로젝트이지만 몇 가지 데모가 공개되었습니다. 예를 들어 아래의 동영상은 GGML과 whisper.cpp 를 이용해 음성으로 명령을 입력하고 있는 모습입니다. 이것뿐이라면 평범한 광경이지만, 이것이 Raspberry Pi 라는 초경량 PC에서 동작하고 있다는 것이 대단한 점입니다.

또한, 130억 파라미터(13B)의 LLaMA와 Whisper를 조합한 모델을 동시에 4대의 Apple M1 Pro 상에서 동작시키는 데모도 있어, 그 가벼움을 마음껏 어필하고 있습니다.

Apple M2 Max에서 70억 파라미터(7B)의 LLaMA 모델을 동작시키면, 초당 40 토큰을 처리할 수 있으며, 이는 상당한 속도입니다.

그 외의 테스트 결과는 아래와 같습니다.

GGML은 MIT 라이센스로 제공되며 누구나 무료로 사용할 수 있습니다. 또한 개발팀은 "코드를 작성하여 라이브러리를 개선하는 것이 가장 큰 지원이 될 것"이라고 말하면서 개발 협력자를 널리 모집하고 있습니다.

덧붙여, 저도 한 번 실제로 동작하는지 확인해 보았습니다만, 문서의 기재대로 진행하고 있었는데 빌드 에러가 나면서 진행할 수 없었습니다.

아직 개발 중이라고 명시했듯이, 완성도와 안정성 면에서 좀 더 시간이 필요한 것 같습니다.

'AI · 인공지능 > AI 뉴스' 카테고리의 다른 글

| 구글「Bard」가 백그라운드로 코드를 실행하는 '암묵적 코드 실행'을 도입 (2) | 2023.06.09 |

|---|---|

| DeepMind가 심층 강화 학습을 이용해 알고리즘을 개선하는 AI 「AlphaDev」를 발표 (2) | 2023.06.09 |

| 「일본은 AI 기술 개발에 전력을 다하고 있다」는 지적, 일본은 무엇이 다른가? (2) | 2023.06.08 |

| 유엔 사무총장이 AI 기술규제를 향한 국제자문기관의 설치를 제언 (3) | 2023.06.08 |

| 적은 GPU 메모리로 대규모 언어 모델을 트레이닝 하는 기법 「QLoRA」가 등장 (4) | 2023.06.07 |

| 「ChatGPT」로부터 대답을 잘 끌어내기 위한 OpenAI의 공식 가이드 (3) | 2023.06.07 |

| 요리 영상을 보는 것만으로 그 요리를 재현할 수 있는 「로봇 셰프」의 실험에 성공 (3) | 2023.06.07 |

| 오픈 소스로 상용 이용도 가능한 대규모 언어 모델 「Falcon」이 등장, 오픈 소스 모델 중 최고의 성능 (4) | 2023.06.07 |