대규모 언어 모델(LLM)을 불과 4GB 정도의 실행 파일 1개로 간편하게 배포 및 실행할 수 있도록 한 패키지 「 llamafile v0.7 」 가 공개되었습니다. 이 버전에서는 CPU와 GPU 둘 다 계산 성능 및 정밀도가 향상되어, 명령 세트 아키텍처 「AVX-512」의 서포트에 의해, AMD의 「 Zen4 」 아키텍쳐 채용 CPU등에서 프롬프트 처리 시간이 10배 고속화된다고 합니다.

Release llamafile v0.7 · Mozilla-Ocho/llamafile · GitHub

https://github.com/Mozilla-Ocho/llamafile/releases/tag/0.7

Release llamafile v0.7 · Mozilla-Ocho/llamafile

llamafile lets you distribute and run LLMs with a single file This release improves the performance and accuracy of both CPU and GPU computations in addition to security. tinyBLAS now gives outpu...

github.com

Llamafile 0.7 Brings AVX-512 Support: 10x Faster Prompt Eval Times For AMD Zen 4 - Phoronix

https://www.phoronix.com/news/Llamafile-0.7

Llamafile 0.7 Brings AVX-512 Support: 10x Faster Prompt Eval Times For AMD Zen 4 - Phoronix

Michael Larabel is the principal author of Phoronix.com and founded the site in 2004 with a focus on enriching the Linux hardware experience. Michael has written more than 20,000 articles covering the state of Linux hardware support, Linux performance, gra

www.phoronix.com

LLaMA Now Goes Faster on CPUs

https://justine.lol/matmul/

LLaMA Now Goes Faster on CPUs

I wrote 84 new matmul kernels to improve llamafile CPU performance.

justine.lol

"llamafile"은 대부분의 시스템에서 실행 가능한 단일 파일로 LLM을 제공함으로써 개발자와 엔드 유저가 LLM을 쉽게 이용하고 배포할 수 있도록 한 구조입니다.

2024년 3월 31일에 출시된 'llamafile v0.7'에서는 CPU에서의 프롬프트 처리 속도가 크게 향상된 것으로 보고되었습니다.

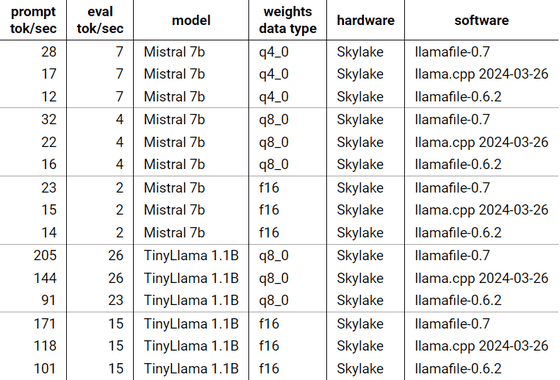

기술자 저스틴 타니는 'llamafile v0.7'과 'llamafile v0.6.2' 및 llamafile에도 포함된 고속화 툴인 'llama.ccp 2024-03-26'을 실행하여 처리 속도의 차이를 보여줍니다.

타니 씨의 수중에 있던 2020년제의 HP 단말(Intel Core i9-9900 탑재)의 실행 결과입니다. 다양한 모델과 파라미터로 수행한 결과, llamafile v0.7이 탁월한 결과를 보여준다는 것을 알 수 있습니다.

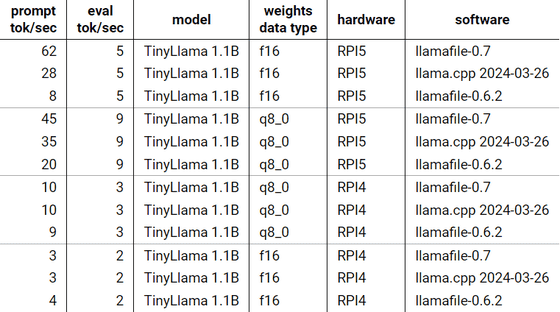

또한 Tany는 Raspberry Pi v5(ARMv8.2)와 Raspberry Pi v4(ARMv8.0)에서 실행 결과를 보여줍니다. Raspberry Pi v5에서는 이전 버전에 비해 최대 8배 가까운 차이가 발생합니다.

릴리즈에 따르면, llamafile v0.7은 Intel의 명령 아키텍쳐 「AVX-512」 를 서포트한 것으로, Zen4 아키텍쳐등의 환경에서는, 처리 속도가 10배 빨라진다는 것입니다.

'AI · 인공지능 > AI 뉴스' 카테고리의 다른 글

| 세계 최초의 완전 자율형 AI 엔지니어 「 Devin 」 등장 (55) | 2024.04.04 |

|---|---|

| AI에게 가장 많이 빼앗긴 프리랜서 직업은 무엇? 데이터 기반 분석 결과 (51) | 2024.04.04 |

| OpenAI가 계정없이도 무료로 ChatGPT를 누구나 사용 가능하게 하겠다고 발표 (54) | 2024.04.03 |

| 운송업계에 혁명을 가져오는 「자율주행 트럭」 이 미국에서 곧 고속도로 주행을 시작 (53) | 2024.04.03 |

| 제대로 체크하면 「781년」 걸리는 AI용 데이터 세트 「LAION-5B」 를 논하는 「Models All The Way Down」 (56) | 2024.04.02 |

| 한국의 2024년 2월 칩 생산량은 AI 수요로 인해 전년 대비 65.3% 증가 (57) | 2024.04.02 |

| 「Llama 2 70B」와 「Stable Diffusion XL」이 추가된 AI 벤치마크 테스트 「MLPerf Inference v4.0」 발표 (56) | 2024.03.29 |

| Databricks가 오픈한 대규모 언어 모델 「 DBRX 」 를 릴리스, GPT-3.5나 CodeLLaMA-70B를 웃도는 성능 (58) | 2024.03.29 |