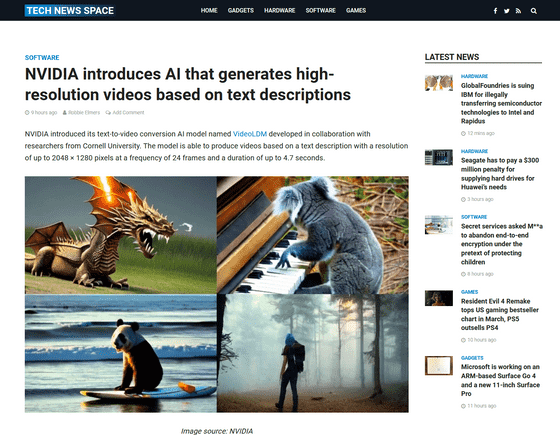

NVIDIA가 미국의 코넬 대학과 공동으로 개발한 AI 모델 "Video Latent Diffusion Model(VideoLDM)"을 발표했습니다. VideoLDM은 텍스트로 입력한 설명에 따라 최대 2048 x 1280픽셀 해상도, 24fps 동영상을 최대 4.7초까지 생성할 수 있습니다.

Align your Latents: High-Resolution Video Synthesis with Latent Diffusion Models

https://research.nvidia.com/labs/toronto-ai/VideoLDM/

NVIDIA Introduces AI That Generates High-resolution Videos Based On Text Descriptions - Tech News Space

NVIDIA Introduces AI That Generates High-resolution Videos Based On Text Descriptions - Tech News Space

NVIDIA introduced its text-to-video conversion AI model named VideoLDMdeveloped in collaboration with researchers from Cornell University. The model is able

technewsspace.com

NVIDIA가 발표한 VideoLDM에는 최대 41억 개의 매개변수가 있지만, 그중 교육에 사용한 동영상은 27억 개입니다. 이것은 AI 개발의 기준으로 치면 상당히 겸손한 수준입니다만, NVIDIA는 효율적인 잠재 확산 모델(Latent Diffusion Model:LDM)에 의해 고해상도로, 시간적으로 일관성 있고, 다양한 동영상을 작성할 수 있는 모델 개발에 성공했습니다.

VideoLDM이 생성한 동영상의 예는 다음과 같습니다. "A teddy bear is playing the electric guitar, high definition, 4k(테디 베어가 일렉트릭 기타를 연주하고 있다. 고화질. 4K)"라는 프롬프트에 의해, 클레이 애니메이션과 같은 정취가 있는 테디 베어의 애니메이션을 고화질로 생성할 수 있었습니다.

VideoLDM의 특징은 크게 두 가지가 있습니다. 첫 번째는 개인화된 영상의 생성입니다. VideoLDM은, 특정 이미지를 사후 학습시키는 「DreamBooth」기법으로 조정하는 것으로, 개인화된 「텍스트로부터 동영상의 합성(text-to-video)」을 실시할 수 있습니다.

예를 들어, 다음과 같은 고양이 이미지를 사용했다고 가정합시다.

그 후, 잔디에서 노는 고양이의 동영상을 생성하도록 지시하면 아래와 같이 원본 이미지와 같은 고양이가 등장하는 동영상이 생성됩니다.

또 하나가 시간 내 컨벌루션 합성(Convolutional-in-Time Synthesis)이라는 것. 이렇게 하면 화질이 약간 떨어지지만 24fps에서 174프레임, 즉 7.3초 길이의 영상을 만들 수 있습니다.

VideoLDM은 2023년 6월 18일부터 캐나다 밴쿠버에서 열리는 기술 컨퍼런스 'Machine Vision and Pattern Recognition Conference'에서 발표될 예정입니다. 어디까지나 연구 단계의 프로젝트이기 때문에, 이것이 NVIDIA의 서비스나 제품에 어떻게 전개될지는 아직 알 수 없습니다.

'AI · 인공지능 > 이미지 생성 AI' 카테고리의 다른 글

| 「Stale Diffusion」개발사가 텍스트로 애니를 생성할 수 있는 「Stable Animation SDK」릴리즈 (5) | 2023.05.15 |

|---|---|

| OpenAI가 텍스트와 이미지로 3D 모델을 생성하는 오픈 소스 AI 「Shap-E」를 발표 (0) | 2023.05.10 |

| 업 스케일링 API를 「Stable Diffusion」개발사인 Stability AI가 발표 (0) | 2023.05.03 |

| 「Stable Diffusion」개발사가 문자 표현도 자연스러운 이미지를 생성 AI「DeepFloyd IF」발표 (0) | 2023.05.02 |

| 손그림을 애니로 변환하는 오픈 소스 프로젝트「Animated Drawings」를 Meta AI가 릴리즈 (0) | 2023.04.14 |

| 「Stable Diffusion + Multi ControlNet」으로 실사같은 애니메이션을 생성 (0) | 2023.04.13 |

| 이미지 생성 프롬프트를 사진이나 일러스트로 검색할 수 있는 「unprompt.ai」 (0) | 2023.04.05 |

| 이미지 생성 AI를 대폭 강화한 「Stable Diffusion XL」베타판 사용 리뷰 (0) | 2023.04.05 |