5.6. 우도(尤度)와 최우추정법

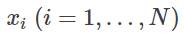

앞에서 「확률 변수가 취할 수 있는 다양한 값에 확률을 대응시키는」 확률 분포를 표 형태로 표현했습니다. 여기서 확률 변수 X가 x값을 취할 확률 p(X=x)를, 표 대신에 어떠 매개 변수 θ로 특징짓는 함수

로 표현해 보겠습니다.

이 함수는 「확률 변수 X가 취할 수 있는 다양한 값 x에 확률을 대응시키기」 때문에, X의 확률 분포를 나타냅니다. 이러한 함수는 확률 모델(probabilistic model)이라고도 불리며, 특히 매개변수에 의해 모양이 결정되는 함수를 이용하는 경우는 파라메트릭 모델(parametric model)이라고 합니다.

이러한 확률 모델의 파라미터를 잘 결정하여, 데이터의 분포를 표현할 수 있다면, 미지의 데이터에 대해서도 그것이 어떤 확률로 발생할지 예측이 가능합니다. 추정 방법에는 여러 가지가 있으며, 어떻게 추정할지는 추정하는 사람 맘이지만, 여기에서는 가장 일반적인 방법 중 하나인, 최대우도법을 설명합니다. 최대우도법은 확률 이론으로부터 정당화할 수 있다는 장점이 있습니다.

확률 모델이 얼마나 실제 관측 데이터와 일치하는지를 우도(likelihood)라고 하며, 관측된 데이터를 모델에 입력해, 그 출력을 대응시킨 것으로 정의됩니다.

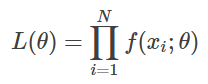

예를 들어, N개의 데이터

가 독립적으로 관찰될 때, 이 관측 데이터의 확률 모델

의 우도는

로 계산됩니다. 주어진 데이터에서 "어떤 데이터가 얼마나 자주 관측되는지"를 나타내는 확률 분포를 추정하기 위해 미리 준비한 확률 모델의 파라미터를, 그 관측 데이터에서 우도가 최대가 되도록 결정하는 방법을 최우추정법(maximum likelihood estimation)이라고 합니다. 위 식의

기호는

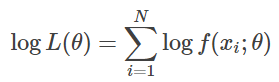

∑의 곱셈 버전으로 모든 값을 곱하는 것을 의미합니다. 여러 데이터에 대한 우도는 1보다 작은 값을 곱한 값이 되기 때문에 결과는 매우 작은 숫자를 컴퓨터에서 계산할 때 언더플로우 문제가 발생하기 쉬워집니다. 또한 우도를 최대화하려 할 때, 곱의 형태의 식을 극대화 하는 것은 어렵다고 알려져 있습니다. 그래서 우도의 로그를 취한 로그 우도(log likelihood)를 사용합니다. y=log(x)는 단조 증가하기 때문에 로그를 취하기 전후로 대소 관계는 바뀌지 않습니다. 따라서 로그 우도를 최대화할 때 θ는, 원래의 우도도 최대로 합니다.

따라서, 이 로그 우도를 최대화하는 파라미터 θ를 구할 수 있다면, 그 값이 관측 데이터

의 분포를 가장 잘 표현하는 확률 모델의 매개 변수입니다.

5.6.1. 예 : 동전 던지기의 매개 변수 추정

여기에서 구체적인 예로서 동전의 앞/뒷면이 나올 확률을 추정하는 문제를 생각해 보겠습니다. 동전을 던져 "앞면이 나오는" 사건을 1로, "뒷면이 나오는" 사건을 0으로 매핑하는 확률 변수를 X라 합시다. 이때, p(X)를 심플한 확률 모델

로 표현할 수 있습니다(이 함수는 베르누이 분포라는 이름이 붙어 있습니다). 이것은 x=1일 때, 즉 동전이 앞면인 경우 θ를 그대로 돌려주고, x=0일 때, 즉 동전이 뒷면인 경우 1- θ를 반환하는 함수가 있습니다. 단, 0 ≤ θ ≤ 1을 충족합니다. 지금 동전을 10회 던져서 아래의 관측 결과를 얻었다고 합니다.

|

|

1회 |

2회 |

3회 |

4회 |

5회 |

6회 |

7회 |

8회 |

9회 |

10회 |

|

X |

1 |

0 |

1 |

1 |

1 |

0 |

0 |

1 |

0 |

0 |

이러한 관측 데이터에서의 확률 모델의 우도는

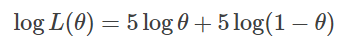

입니다. 로그 우도는

입니다. 이것이 최대가 될 때의 θ는, 이 식을 θ로 미분한 식을 0으로 놓고 해석적으로 풀면

로 결정이 됩니다. 이것이 최우추정법입니다.

[딥러닝 입문 5] 확률·통계의 기초(4/5)

5.7. 사후 확률 극대화 추정 (MAP 추정) 앞에서 해설한 최우추정은 많은 경우에 유용하지만, 요청 매개 변수에 대해 어떤 사전 지식이 있어도 그것을 활용할 수 없습니다. 따라서 샘플 크기가 작은

doooob.tistory.com

'AI · 인공지능 > 딥러닝 Tutorial' 카테고리의 다른 글

| [딥러닝 입문 - 6] 단일 회귀 분석과 다중 회귀 분석(2/4) (0) | 2021.06.03 |

|---|---|

| [딥러닝 입문 - 6] 단일 회귀 분석과 다중 회귀 분석(1/4) (0) | 2021.05.30 |

| [딥러닝 입문 5] 확률·통계의 기초(5/5) (0) | 2021.05.15 |

| [딥러닝 입문 5] 확률·통계의 기초(4/5) (0) | 2021.03.09 |

| [딥러닝 입문 5] 확률·통계의 기초(2/5) (0) | 2021.02.12 |

| [딥러닝 입문 5] 확률·통계의 기초(1/5) (0) | 2021.01.18 |

| [딥러닝 입문 - 4] 선형 대수의 기초(9/9) (0) | 2020.07.28 |

| [딥러닝 입문 - 4] 선형 대수의 기초(8/9) (0) | 2020.07.26 |