VTuber(버추얼 유튜버) · AR · VR용으로, 웹캠으로 촬영한 얼굴 및 전신의 움직임을 3D아바타로 리얼타임 반영시킬 수 있는 모션 캡처 기술 「SysMocap」이 공개되었습니다.

Windows · macOS · Linux에서 동작하며, 로컬 환경에서 무료로 간단하게 적용할 수 있습니다.

GitHub - xianfei/SysMocap: A real-time motion capture system for 3D virtual character animating.

https://github.com/xianfei/SysMocap

GitHub - xianfei/SysMocap: A real-time motion capture system for 3D virtual character animating.

A real-time motion capture system for 3D virtual character animating. - GitHub - xianfei/SysMocap: A real-time motion capture system for 3D virtual character animating.

github.com

SysMocap을 설치하려면 Node.js 설치가 필요합니다.

Node.js설치 방법은 아래 글을 참고하세요.

사이트의 다양한 페이지 실적을 함께 측정할 수 있는 도구 「Unlighthouse」

「Lighthouse」 는 Google이 작성한 페이지의 로딩 속도나 접근성 등을 정리해 체크・채점해 주는 툴입니다만, 그 Lighthouse를 사이트상의 다양한 페이지에서 동작시키는 것으로 사이트 전체의 스코어

doooob.tistory.com

Node.js를 설치한 다음 터미널에서 git clone https://github.com/xianfei/SysMocap.git 을 입력하여 리포지토리를 복제합니다.

cd SysMocap을 입력하여 SysMocap의 로컬 리포지토리로 이동합니다.

npm i 를 입력하고 실행.

npm start 를 입력하고 실행합니다.

그러면 SysMocap 창이 시작됩니다. SysMocap이 지원하는 3D 아바타의 파일 형식은 VRM 형식, GLB 형식, FBX 형식으로 자신의 파일을 읽을 수 있으며, 기본적으로 9 종류의 아바타가 수록되어 있습니다.

상단에서 "SETTING"을 선택하고 "Input"에서 카메라를 선택합니다.

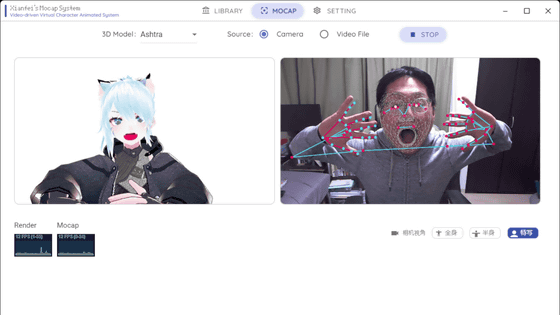

다음으로, 상단의 「MOCAP」를 선택, 3D Model에서 3D 아바타를 선택하고 Source에서 Camera를 선택한 다음 START를 클릭합니다.

그러면 아바타와 함께 웹캠 영상이 나옵니다. 웹캠에 비친 자신의 얼굴과 몸에는 인식을 나타내는 선이 표시됩니다. 카메라 화상 아래에는 「전신」 ,「반신」, 「특사(특별한 사진)」이라는 옵션이 있어, 특사는 가슴 위 상체를 인식시키는 모드입니다.

일본의 한 VTuber가 올린 사용후기가 있어서 이미지를 가져와 봤습니다.

얼굴의 방향, 입이나 손의 움직임에 반응하며 아바타도 움직입니다.

"반신"은 상반신의 움직임을 인식합니다.

"전신"은 전신의 움직임을 인식합니다.

'트렌드 이슈 · 토픽' 카테고리의 다른 글

| 우주와 지상간의 레이저 통신이 초당 200GB를 달성하여 신기록 수립, 5분 만에 2테라바이트 전송 가능 (2) | 2023.06.02 |

|---|---|

| 천둥의 원리로 공기 중의 「습기」로부터 24시간 365일 클린 에너지를 얻는 신기술 등장 (13) | 2023.05.31 |

| 알리바바 클라우드가 주최한 블록체인 게임 해커톤 '#asobiHack_Tokyo' 수상작 소개 (19) | 2023.05.30 |

| 흑인 노예를 매매하고 부를 축적해 나가는 게임 「Slavery Simulator」를 앱 스토어에서 허가했다고 Google이 고소당함 (9) | 2023.05.30 |

| 대상 포진 백신이 치매 예방에 효과적이라는 증거 발견, 치매 예방에 새로운 광명 (4) | 2023.05.30 |

| 사이트의 다양한 페이지 실적을 함께 측정할 수 있는 도구 「Unlighthouse」 (2) | 2023.05.28 |

| 신형 코로나 바이러스 감염 후유증 「롱 COVID」로 인해 면역시스템이 변해버릴 가능성 (7) | 2023.05.26 |

| 메모리가 어떻게 할당되고 해제되는지 알기 쉽게 설명한 「Memory Allocation」 (2) | 2023.05.25 |